基于大语言模型的时序知识图谱推理研究

本文最后更新于:2 个月前

基于大语言模型的时序知识图谱推理研究

开题研究方向探讨

汇报人:范财胜

所属单位:华中科技大学

汇报时间:2025-09-09

联系方式:csfan@hust.edu.cn

1 📜 研究背景与动机

1.1 研究现状

知识图谱(Knowledge Graph, KG)作为一种结构化的数据表示形式,通过实体和关系构成的三元组 $⟨s,r,o⟩$ 来描述现实世界中的事实。传统的静态知识图谱无法有效反映现实世界的动态演变,例如社交网络关系、公司并购事件、或流行病传播等。为了捕捉这种时变的特性,2016年时序知识图谱(Temporal Knowledge Graph, TKG) 应运而生。TKG 将事实扩展为四元组 $⟨s,r,o,t⟩$,其中 s、 o 分别代表主体和客体实体,r 代表关系,t 代表时间戳,可以是离散的时间点或连续的时间区间。这种数据结构能够更精确地描绘事件发生的时间,使得对现实世界的建模更加真实和细致。

(研究员 A, 合作, 研究员 B, 2024-01)(研究员 C, 工作单位为, D 大学, 2022)

时序知识图谱推理(Temporal Knowledge Graph Reasoning, TKGR) 是该领域的核心任务之一,其目标是在给定历史事实的情况下,预测图中缺失或未来的事实。该任务与静态知识图谱推理的根本区别在于,TKGR 不仅需要学习图结构中的空间依赖性,还要捕捉实体和关系在时间维度上的动态演化模式。

然而,传统的 TKGR 方法,如基于图神经网络(GNN)或规则挖掘的模型,虽然在特定基准上取得了显著进展,但普遍存在以下局限性:

- 缺乏可解释性: 多数深度学习模型是“黑盒”,难以解释其推理过程与决策依据。这在需要高可信度的应用场景(如金融、医疗、司法)中是致命的缺陷。

- 泛化能力弱: 传统模型主要学习历史数据的统计关联性,而非深层的因果关系。这使得它们在面对数据分布偏移或未来新事件时(即外推任务)表现脆弱。

- 知识时效性差: 传统模型通常需要耗时耗力地重新训练才能整合新知识。

大语言模型(Large Language Model, LLM)的出现为解决上述难题提供了新的思路。LLM 凭借其在海量文本数据上预训练所获得的强大自然语言理解、常识推理和跨领域知识,被视为增强 TKG 推理能力的关键。LLM 与 TKG 的融合被认为是“软性”与“硬性”知识的互补:LLM 提供灵活、强大的语言理解和推理能力,而 TKG 提供结构化、精确、可溯源的知识。

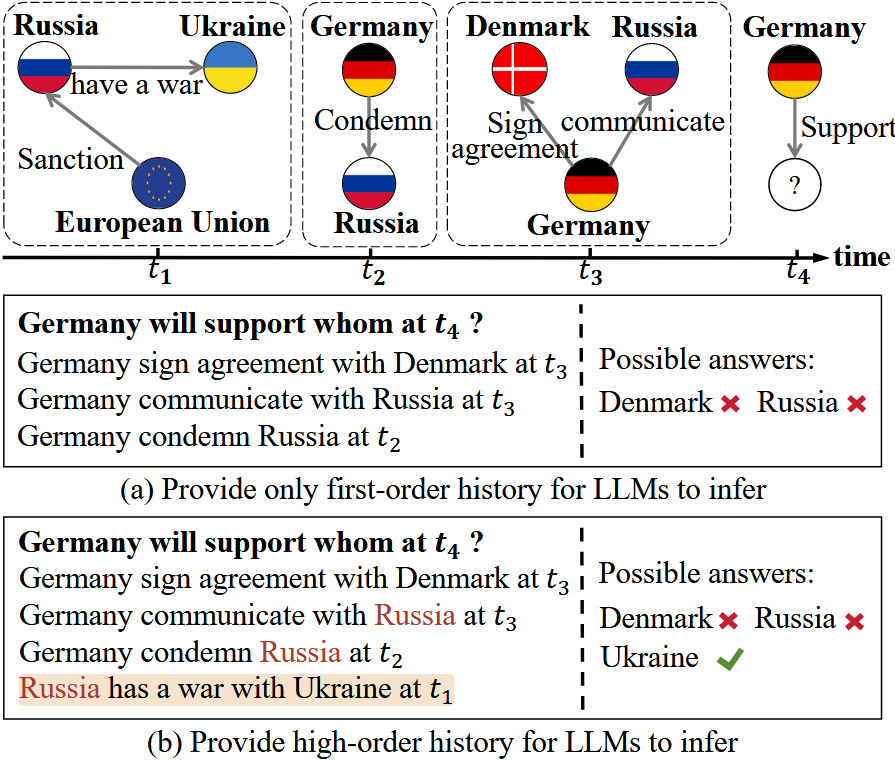

使用LLM对TKG推理示例

在(a)和(b)中,为LLM提供了不同的历史,促使LLMS为预测的事实推理了不同的答案。

1.2 研究动机

- 基础能力层:LLM 如何有效融入 TKG 推理,以平衡准确性、可解释性和计算效率。

- 下游应用层:

- 构建科研时序知识图谱进行科研态势预测或者科研项目(合作者)推荐。

- 构建法律法规和司法案件时序知识图谱进行判决预测。

2 ❓ 核心研究问题

如何设计一个框架,让 LLM 能够“理解”并“利用”TKG 中的时序结构和演化模式?

例如,是将 TKG 子图转化为 Prompt(KG-LLM),还是让 LLM 学习 TKG 的嵌入表示?LLM 在 TKG 推理中应承担何种角色?

是作为最终的预测器(Generator),还是作为中间的推理规划器(Planner),或是用于生成可解释的推理链?该框架能否为社科科研乃至其它领域的应用提供有效支撑?

该框架对知识图谱推理能力的增强是否适用于通用领域,对垂直领域的适配有没有特殊要求或者局限性(数据层面:数据稀疏、领域特性:可解释性要求强)?

3 📊 拟采用方法与技术路线

3.1 核心架构设想

| 技术路线 | 规则提取与动态适应路线 | 时序感知检索增强生成(Temporal - aware RAG)路线 | 链式历史推理与 Graph - LLM 混合路线 |

|---|---|---|---|

| 代表模型 | ==LLM-DA (NeurIPS 2024)== | ==TimeR4 (EMNLP 2024)、GenTKGQA (ACL Findings 2024)== | ==CoH (ACL 2024)、TGL-LLM (arXiv 2025)== |

| 核心方法 | 利用 LLMs 从历史数据提取时序逻辑规则,并通过动态适应策略(dynamic adaptation strategy)更新规则集,以应对时序分布偏移。 | 通过检索历史事实来增强 LLMs 生成。该路线强调时序约束过滤和负采样。 | 链式推理将复杂任务分解为可管理步骤,解决了 LLM 上下文长度限制,融合图结构信号与 LLM 生成。 |

| 技术路线 | 规则提取与动态适应路线 | 时序感知检索增强生成(Temporal - aware RAG)路线 | 链式历史推理与 Graph - LLM 混合路线 |

|---|---|---|---|

| 优势 | 高可解释性(逻辑规则路径);无需昂贵模型微调,能高效处理知识更新;零样本适应性强,适用于稀疏 TKGs。 | 显著提升复杂问答性能;鲁棒性强,可处理多粒度时序信息;无需全量训练,资源高效。 | 捕捉多跳历史,提供可解释的推理链;擅长处理长尾实体和跨域泛化问题。 |

| 局限 | LLM 规则生成过程依然是“黑盒”;规则质量高度依赖 LLM 生成能力;在处理某些长尾实体时准确率可能低于65%;存在幻觉率,规则验证需额外检查。 |

检索延迟可能较高;对齐失败率较高;可能忽略多跳推理路径。 |

多步调用可能累积误差;历史长度过长可能引入噪声;依赖资源密集型微调;部分研究中训练时间较长。 |

| 适用场景 | ==动态环境(如实时新闻 TKG),需要可解释的外推预测;资源中等,对持续更新要求高的任务。== | ==复杂的时序问答(如事件跨年查询),多模态事实检索;隐式问题强,部署延迟敏感。== | ==稀疏多跳历史(如社会网络),长尾实体预测;需要高可解释性的场景,但计算密集。== |

3.2 关键技术点

时序 Prompt 工程:如何将时间戳、时序关系和演化模式有效编码为 LLM 可理解的 Prompt,以确保生成结果符合时序约束?

例如:如何设计Prompt模板(如“在t=2023年,基于历史链[A→B→C],预测下一事件”)以捕捉多粒度时序(日/月/年)并减少幻觉?

可解释性机制:如何设计输出推理链条或逻辑规则的机制,以增强 TKGs 推理的可追溯性和可验证性?

例如:如何在CoH或LLM-DA中生成可解释的推理路径,并验证其与子图匹配的一致性?

幻觉缓解策略:如何通过外部知识(如检索或图信号)或约束机制(如负采样、时间过滤)减少 LLM 在 TKGs 推理中的幻觉?

例如:如何在RAG中优化负采样生成,降低O(n^2)复杂性并减少对齐失败率?

多跳推理优化:如何设计算法或架构以支持复杂多跳推理,捕捉长期历史依赖,同时控制计算复杂性?

例如:如何通过链式提示或子图分解,提升多跳外推场景的Hits@1(回答排序第一且正确的比例)?

长尾实体与稀疏数据处理:如何提升 LLM 在稀疏 TKGs 或长尾实体上的推理性能,克服数据不平衡问题?

例如:如何通过嵌入增强或规则泛化,改善长尾实体推理的准确率?

资源效率与可扩展性:如何在资源受限环境中(如单 GPU 或边缘设备)优化 LLM-TKG 推理,降低训练/推理时间?

例如:如何通过参数高效微调(如LoRA)或检索剪枝,使推理延迟从>1s降至毫秒级,适用于实时新闻TKGs?

4 ⚠️ 预期挑战与解决方案

| 挑战 (Challenge) | 描述 (Description) | 解决方案 (Solutions) | 相关研究 (Related Work) |

|---|---|---|---|

| 时序-语义鸿沟 (Temporal-Semantic Gap) | LLM擅长处理自然语言的语义,但对精确的时间戳、时序依赖和动态演化模式缺乏原生理解能力。==如何将TKG中结构化的时序信息(如“2024-01-01”)有效“翻译”成LLM能理解并利用的语义信号==,是一个核心难题。 | 时序Prompt工程: 设计专门的提示模板,将时间信息编码为自然语言描述(如“在2024年初”、“事件发生后的三个月内”)。 | 《Pre-trained Language Model with Prompts for TKG Completion》 (PPT) 通过将时间间隔转化为提示词。 《SToKE》通过构建事件演化树(EET)将 TKG 结构化为序列,使 LLM 能处理。 |

| 挑战 (Challenge) | 描述 (Description) | 解决方案 (Solutions) | 相关研究 (Related Work) |

|---|---|---|---|

| 数据稀疏与长尾实体 (Data Sparsity & Long-tail Entities) | ==TKG中大量实体是“长尾”的,仅有少量观测数据==。LLM的微调严重依赖数据,面对新实体或稀疏实体时容易失效。 | 少样本/零样本学习: 采用元学习(Meta-Learning)框架,让模型学会“如何从少量样本中学习”。 | 《Learning to Sample and Aggregate: Few-shot Reasoning over TKGs》 (MetaTKGR) 提出元学习框架,动态采样和聚合邻居信息。 |

| 灾难性遗忘 (Catastrophic Forgetting) | TKG是动态演化的,新事件不断涌现。==在持续学习新知识的过程中,模型可能会遗忘旧的重要模式==,导致历史知识的性能下降。 | 经验回放: 有选择地存储和重放过去的关键事件或实体表示。 正则化技术: 引入正则化项,约束模型参数的更新,保护对旧知识重要的参数。 |

《History Repeats: Overcoming Catastrophic Forgetting…》提出基于聚类的经验回放和时间正则化。 |

| 挑战 (Challenge) | 描述 (Description) | 解决方案 (Solutions) | 相关研究 (Related Work) |

|---|---|---|---|

| 复杂推理能力不足 (Insufficient Complex Reasoning) | ==LLM可能擅长单跳推理,但在处理需要多跳、因果或反事实的复杂时序推理时表现不佳==。例如,难以捕捉“事件A是事件B的前驱”这种间接依赖。 | 思维链提示: 设计Prompt引导LLM生成中间推理步骤。 引入外部推理模块: 将 LLM 与专门的时序推理模型(如 TiRGN, CENET)结合,让 LLM 负责语义理解,专用模块负责复杂时序计算。 |

《Chain-of-History…》逐步探索高阶历史,从而使LLM在TKG预测中能够有效利用高阶历史信息 |

| 可解释性与可信度 (Explainability & Trustworthiness) | ==LLM常被视为“黑盒”,其推理过程不透明==。在法律、金融等高风险领域,用户需要知道“为什么”会得出某个预测结果。 | 规则引导的推理: 将LLM的输出与从TKG中挖掘的时序逻辑规则(如TLogic)相结合,用规则为LLM的预测提供解释。 | 《TLogic…》强调了提供基于因果或逻辑的可解释性。 |

5 💬 开放讨论与寻求建议

- 该研究的可行性和应用场景的适配性(==是否适合司法判决预测、或者科研项目合作者推荐,效果提升是否显著==)?

- 在上述三种架构技术路线中,您认为哪一种更具研究价值和可行性?

- 根据上述调研结果,该研究在此基础上

有哪些潜在创新点和侧重点?

参考文献

[1] Wei, W., et al. “Large Language Models-guided Dynamic Adaptation for Temporal Knowledge Graph Reasoning.” NeurIPS, 2024. arXiv:2405.14170.

[2] Jin, Z., et al. “Time-aware Retrieval-Augmented Large Language Models for Temporal Knowledge Graph Question Answering.” EMNLP, 2024.

[3] Wang, Y., et al. “Chain-of-History Reasoning for Temporal Knowledge Graph Forecasting.” ACL Findings, 2024. arXiv:2402.14382.

[4] Li, X., et al. “Chain of History: Learning and Forecasting with LLMs for Temporal Knowledge Graph Completion.” arXiv:2401.06072, 2024.

[5] Chen, H., et al. “Integrate Temporal Graph Learning into LLM-based Temporal Knowledge Graph Model.” arXiv:2501.11911, 2025.

[6] Li, M., et al. “Two-stage Generative Question Answering on Temporal Knowledge Graphs.” ACL Findings, 2024. ACL Anthology

[7] Zhang, L., et al. “Large Language Model with Iteratively Prompt for Temporal Knowledge Graph Completion.” Neurocomputing, 2025.